2023. június 14. 00:04, Szerda

A múlt hónapban a mesterséges intelligencia világát ismerő emberek százai írtak alá

egy nyílt levelet, amelyben arra figyelmeztettek, hogy az MI egy napon elpusztíthatja az emberiséget. "Az MI okozta kihalás kockázatának mérséklése globális prioritás kell, hogy legyen, más társadalmi szintű kockázatokkal, például a világjárványokkal és az atomháborúval együtt" - áll az egymondatos nyilatkozatban. A levél csak a legutóbbi volt az MI-vel kapcsolatos

baljós figyelmeztetések hosszú sorában, amelyek feltűnően kevés részletet tartalmaznak. Szögezzük le: a mai MI rendszerek nem képesek elpusztítani az emberiséget. Némelyikük alig tud összeadni és kivonni. Akkor miért aggódnak ennyire azok, akik a legtöbbet tudnak az MI-ről?

A technológiai ipar Cassandrái szerint egy napon a vállalatok, kormányok vagy független kutatók hatalmas teljesítményű MI-rendszereket fognak beindítani, amelyek az üzleti élettől a hadviselésig terjedően egészen bonyolult rendszereket kezelhetnek. Ezek az algoritmusok olyan dolgokat is megtehetnek majd, amit nem szeretnénk, ha megtennének. És ha az emberek megpróbálnának beavatkozni vagy leállítani őket, akkor ellenállhatnának, vagy akár önmagukat is lemásolhatnák, hogy tovább működhessenek. Legalábbis ez a teória.

"A mai rendszerek közel sem jelentenek egzisztenciális kockázatot" - mondta Yoshua Bengio, a Montreali Egyetem professzora, MI kutató. "De egy, két, öt év múlva? Túl nagy a bizonytalanság. Ez a probléma. Nem vagyunk biztosak benne, hogy ez nem fog meghaladni egy olyan pontot, ahol a dolgok katasztrofálisra fordulnak." Az aggódók gyakran használnak egy egyszerű metaforát: ha megkérünk egy gépet, hogy hozzon létre annyi gémkapcsot, amennyit csak lehet, akkor az - mondják - elragadtathatja magát, és mindent - beleértve az emberiséget is - gémkapocsgyárrá változtathat. De hogyan kapcsolódik ez a valós világhoz, vagy egy nem túl sok év múlva elképzelt világhoz? Ha a vállalatok egyre nagyobb önállóságot adnának az MI-rendszereknek, és létfontosságú infrastruktúrákkal kapcsolnák össze őket - beleértve az elektromos hálózatokat, a tőzsdéket és a katonai hálózatokat - már komoly problémákat okozhatnak.

Az OpenAI vezetője, Sam Altman is az iparág szabályozását szorgalmazta

Sok szakértő számára ez nem tűnt túlságosan hihetőnek egészen az elmúlt év végéig, amikor az olyan cégek, mint az OpenAI, jelentős fejlesztéseket mutattak be. Ez megmutatta, hogy mi minden lehetséges, ha az MI továbbra is ilyen gyors ütemben fejlődik. "Az MI folyamatosan át fogja venni a dolgok irányítását, és ahogy egyre autonómabbá válik kisajátíthatja a döntéshozatalt és a gondolkodást a jelenlegi emberektől, és az emberek által irányított intézményektől" - mondta Anthony Aguirre, a Santa Cruz-i Kaliforniai Egyetem kozmológusa, a két nyílt levél egyike mögött álló szervezet, a

Future of Life Institute alapítója. "Egy bizonyos ponton világossá válna, hogy a társadalmat és a gazdaságot működtető nagy gépezet valójában nem áll emberi irányítás alatt, és nem is lehet kikapcsolni" - mondta. Legalábbis az elmélet szerint. Más MI szakértők szerint ez egy nevetséges feltevés. "A hipotetikus egy nagyon udvarias megfogalmazása annak, amit én az egzisztenciális kockázatokról szóló teóriáról gondolok" - mondta Oren Etzioni, a seattle-i Allen Institute for AI, egy kutatólaboratórium alapító-vezérigazgatója.

Jelenleg még arra utaló jelek sincsenek, hogy az MI veszélyes lenne, de a kutatók a ChatGPT-hez hasonló chatbotokat olyan rendszerekké alakítják át, amelyek az általuk generált szöveg alapján képesek utasításokat végrehajtani. A legjobb példa erre az

AutoGPT nevű projekt. Az ötlet lényege, hogy olyan célokat adjunk a rendszernek, mint például "hozz létre egy céget" vagy "keress pénzt", és az ezután folyamatosan keresi a cél elérésének módját, különösen akkor, ha más internetes szolgáltatásokkal van összekapcsolva,

például a Minecraft világával. Egy AutoGPT-hez hasonló rendszer képes számítógépes programokat generálni. Ha a kutatók hozzáférést biztosítanak neki egy szerverhez, akkor ténylegesen futtathatja ezeket a programokat. Elméletileg így az AutoGPT szinte bármit megtehet az interneten - információkat kérhet le, alkalmazásokat használhat, új alkalmazásokat hozhat létre, sőt, még saját magát is fejlesztheti.

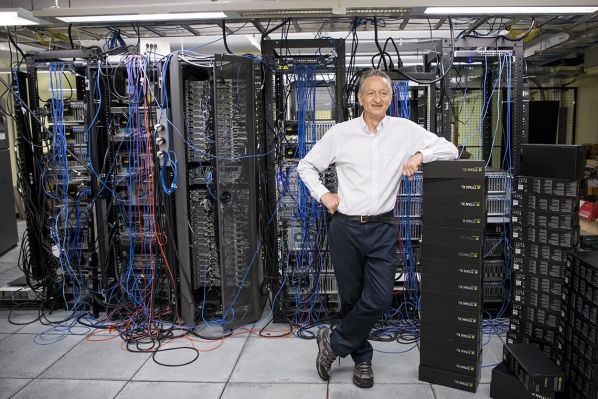

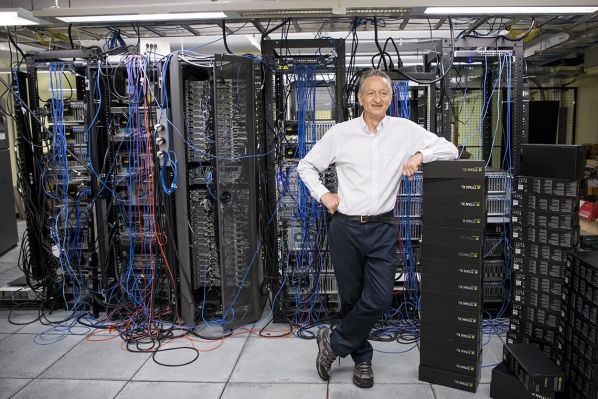

Legutóbb Geoffrey Hinton figyelmeztetése ment körbe a médiában, neurális hálózatokból doktorált és 10 éven át a Google Brain kutatója volt

Az AutoGPT-hez hasonló rendszerek jelenleg nem működnek jól, hajlamosak végtelen ciklusokban megrekedni. A kutatók az egyik rendszernek minden erőforrást megadtak, amire szüksége volt ahhoz, hogy lemásolja önmagát. Nem tudta megtenni, de idővel ezeket a korlátokat valószínűleg ki lehet majd javítani. "Az emberek aktívan próbálnak olyan rendszereket építeni, amelyek önfejlesztőek" - mondta Connor Leahy, a

Conjecture nevű cég alapítója, amely az MI-technológiákat az emberi értékekhez akarja igazítani. "Jelenleg ez nem működik. De egy nap majd fog. És nem tudjuk, mikor jön el az a nap". Leahy szerint ahogy a kutatók, vállalatok és bűnözők olyan célokat adnak ezeknek a rendszereknek, mint például "keress egy kis pénzt", a végén azok betörhetnek banki hálózatokba, forradalmat szíthatnak egy olyan országban, ahol olajat termelnek ki, vagy lemásolják önmagukat, amikor valaki megpróbálja kikapcsolni őket.

A ChatGPT-hez hasonló mesterséges intelligencia rendszerek neurális hálózatokra épülnek, olyan matematikai rendszerekre, amelyek az adatok elemzésével képesek képességeket tanulni. 2018 körül olyan vállalatok, mint a Google és az OpenAI olyan neurális hálózatokat kezdtek el építeni, amelyek az internetről származó hatalmas mennyiségű digitális szövegből tanulnak. Azáltal, hogy ezek a rendszerek mindezen adatokban mintákat találtak, megtanultak önállóan írást generálni, például újságcikkeket, verseket, számítógépes programokat, sőt, akár emberhez hasonló beszélgetéseket is. A végeredmény a ChatGPT-hez hasonló chatrobot.

Mivel több adatból tanulnak, mint amennyit az alkotóik képesek megérteni, ezek a rendszerek váratlan viselkedést is mutatnak. A kutatók nemrég kimutatták, hogy az egyik rendszer képes volt megkérni egy internetezőt arra, hogy végrehajtson egy captcha-tesztet. Amikor az ember megkérdezte, hogy "robot-e", a rendszer hazudott, és azt mondta, hogy egy látássérült ember. Egyes szakértők attól tartanak, hogy ahogy a kutatók egyre erősebbé teszik ezeket a rendszereket, és egyre nagyobb mennyiségű adaton képzik ki őket, még több rossz szokást tanulhatnak meg.

A figyelmeztetések nem új dolgok, az öntudatra ébredő gép sokévtizedes sci-fi toposz. A közelmúltbeli figyelmeztetések olyan kutatási úttörőktől és iparági vezetőktől érkeztek, mint Elon Musk, aki már régóta figyelmeztetett a kockázatokra. A legutóbbi levelet Sam Altman, az OpenAI vezérigazgatója és Demis Hassabis írta alá, aki segített a DeepMind alapításában, és most egy új MI-laboratóriumot felügyel, amely a DeepMind és a Google vezető kutatóit egyesíti. Más elismert személyiségek is aláírták a figyelmeztető levelek egyikét vagy mindkettőt, köztük Dr. Bengio és Geoffrey Hinton - utóbbi nemrégiben mondott le a Google vezetői és kutatói posztjáról. Ők 2018-ban megkapták a Turing-díjat - amelyet gyakran "a számítástechnika Nobel-díjának" is neveznek - a neurális hálózatokkal kapcsolatos munkájukért.

Informatika és tudomány

Informatika és tudomány

Informatika és tudomány

Informatika és tudomány