SG.hu·

Egyre valószínűbb egy mesterséges intelligencia katasztrófa

A mesterséges intelligencia egyszerre ígér hatalmas lehetőségeket és komoly veszélyeket. A kiberbiztonságtól a biológiai fegyverekig egyre több területen jelennek meg az MI valós kockázatai miközben a politikai akarat a korlátozásra gyengül.

Bár határozottnak akart hangzani, Donald Trump akaratlanul is bemutatta azt a bizonytalanságot, amely világszerte kíséri a mesterséges intelligencia gyors fejlődését. Február 27-én az Egyesült Államok elnöke keményen nekiment az Anthropic nevű amerikai MI-laboratóriumnak, amely többek között a védelmi minisztériummal és más kormányzati szervekkel is együttműködik. Trump a közösségi médiában azt írta, hogy utasítja az amerikai kormány minden szövetségi ügynökségét, hogy azonnal hagyjanak fel az Anthropic technológiájának használatával. Azt írta, nincs rá szükségük, nem akarják használni, és a jövőben nem kívánnak üzletelni a céggel. Ám mindössze egy mondattal később azt is megfogadta, hogy az elnöki hatalom teljes erejét felhasználja arra, hogy rákényszerítse az Anthropicot arra, hogy a következő hat hónapban együttműködjön a kormánnyal. A kijelentések alapján úgy tűnt, hogy ezek a szerinte szélsőséges alakok egyszerre jelentenek elviselhetetlen kockázatot az állam működésére nézve, miközben annyira nélkülözhetetlenek is, hogy szükség esetén kényszeríteni kell őket az együttműködésre.

Amióta világossá vált, hogy a mesterséges intelligencia képességei meghaladhatják az emberi képességeket, a világ folyamatosan ezzel a dilemmával küzd. A technológia egyszerre tűnik túl erősnek ahhoz, hogy lemondjanak róla, és túl veszélyesnek ahhoz, hogy teljes mértékben elfogadják. Az Anthropic és Trump közötti konfliktust is az váltotta ki, hogy a vállalat attól tartott, hogy modelljeit rosszindulatú célokra használhatják. Trump és munkatársai ezzel szemben a technológia gyors bevezetését szorgalmazták, minél kevesebb korlátozással. A helyzet ironikus módon azért különösen riasztó, mert az amerikai kormány éppen akkor döntött a gyors előretörés mellett, amikor egyre világosabbá válik, hogy az MI nemcsak elméleti forgatókönyvekben, hanem a valóságban is súlyos károkat okozhat.

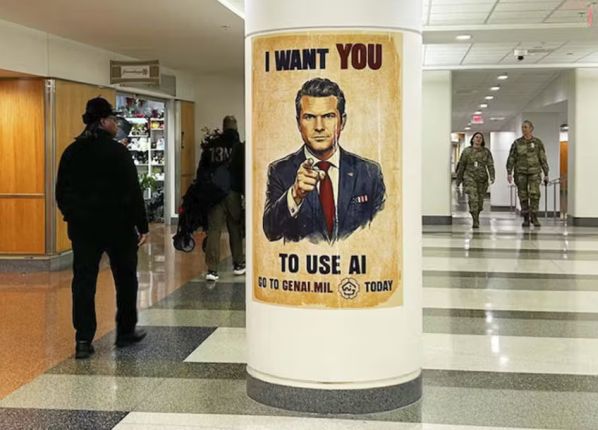

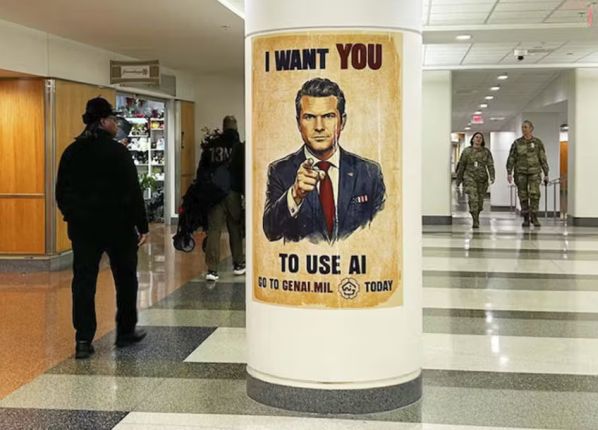

Trump haragja az Anthropic ellen egy tavaly kiadott rendeletéből ered, amely az Egyesült Államok globális MI-dominanciájának fenntartását és erősítését tűzte ki célul. Ez arra ösztönözte Pete Hegseth védelmi minisztert, hogy az idei év elején elrendelje az amerikai hadsereg egészében az ország vezető MI-modelljeivel folytatott kísérleteket. A miniszter azt mondta, hogy a fejlesztéseket a lehető leggyorsabban fel kell gyorsítani. Egy tréfás toborzóplakátot is közzétett, amelyen az Uncle Sam pózában látható, és katonáknak azt üzeni, hogy azt akarja, használják az MI-t. Tavaly J. D. Vance alelnök az MI-biztonsággal kapcsolatos aggodalmakat félrevezető liberális rögeszmének nevezte.

Az adminisztráció sietsége ellenére - vagy talán éppen amiatt - az Anthropic ragaszkodott bizonyos jogi biztosítékokhoz, amelyek megakadályoznák, hogy modelljeit tömeges belföldi megfigyelésre vagy teljesen autonóm fegyverrendszerekben használják. A védelmi minisztérium azonban azt állította, hogy joga van az MI-t bármilyen általa törvényesnek ítélt módon alkalmazni, és azzal vádolta az Anthropicot, hogy gyáva vállalati erényfitogtatást tanúsít, amikor nem hajlandó engedni.

A vita az amerikai kormány számára sem kedvező. Legalább rövid távon az Anthropic nélkülözhetetlen. A Claude nevű nagy nyelvi modell különösen jó számítógépes kód írásában. Emellett február végéig az Anthropic volt az egyetlen MI-labor, amelynek modelljeit engedélyezték titkos katonai adatokkal való használatra. Csak ekkor kapott hasonló engedélyt az xAI nevű rivális cég, annak Grok nevű modelljét azonban sokan hibásabbnak és kevésbé megbízhatónak tartják. Bár egy másik rivális, az OpenAI ugyanazon a napon írt alá szerződést a Pentagonnal, amikor Trump és Hegseth az Anthropic ellen fordult, a rendszer katonai integrációja még időt vesz igénybe. Ráadásul a botrány elriaszthat más MI-cégeket attól, hogy egyáltalán pályázzanak kormányzati megbízásokra. Ki akarna együttműködni egy olyan partnerrel, amely egy konfliktus esetén akár a teljes üzletét is tönkreteheti? Ha az adminisztráció valóban az amerikai MI-vezető szerep megőrzését tartja a legfontosabbnak, akkor az egyik legsikeresebb amerikai MI-vállalat eltiprása nyilvánvalóan ellentétes ezzel a céllal.

A kormány haragját valószínűleg kevésbé az motiválja, hogy valóban használni akarja az Anthropic modelljét a vitatott célokra, mint inkább az, hogy nem tűri a visszautasítást. A kínai kommunista párttal ellentétben, amely bármikor lefoglalhatja az ország MI-iparának termékeit bármilyen célra, az amerikai hatóságoknak figyelembe kell venniük a jogszabályokat és a technológiai vezetők egóját is. Sam Altman, az OpenAI vezetője például azt mondja, hogy az ő cége sem venne részt tömeges belföldi megfigyelésben vagy teljesen autonóm fegyverrendszerek fejlesztésében. Szerinte azonban az OpenAI modelljei már rendelkeznek olyan technikai biztosítékokkal, amelyek megakadályozzák az ilyen felhasználást, ezért nincs szükség további jogi garanciákra.

Az Anthropic valószínűleg nem csupán két hipotetikus felhasználási mód miatt aggódott. Egy olyan iparágban, amely híres arról, hogy nagy ígéreteket tesz a világ jobbá tételére, az Anthropic különösen magas erkölcsi elveket hangoztat. A vállalatot olyan OpenAI-alkalmazottak alapították, akik attól tartottak, hogy korábbi cégük nem tartja magát eléggé szigorúan ahhoz a célhoz, hogy a fejlett MI-t biztonságos és felelős módon fejlessze. Hegseth egyik munkatársa azzal vádolta Amodeit, hogy istenkomplexusa van. Az iparágban uralkodó rendkívül magas fizetések és a legjobb mérnökökért folytatott verseny miatt ezek a szakemberek könnyedén átmehetnek egy másik vállalathoz vagy akár nyugdíjba is vonulhatnak, ha nem tetszik nekik, amit a cégük csinál. Az Anthropichoz gyakran azok kerülnek, akik különösen fontosnak tartják az MI biztonságát.

A vita valójában még erősítette is az Anthropic jó hírnevét. Trump felháborodását követő egy napon belül a Claude lett az Egyesült Államokban az Apple digitális áruházának leggyakrabban letöltött ingyenes alkalmazása. Olyan hírességek, mint Katy Perry popénekes, a közösségi médiában nyilvánosan támogatták a cég termékeit. A Claude rövid időre le is állt, ami az Anthropic szerint a hirtelen megnövekedett használat következménye volt. Amodei tömeges megfigyeléssel kapcsolatos figyelmeztetései szinte marketingüzenetnek is hangozhatnak. Szerinte a jogszabályok nem tartottak lépést az MI hatalmas adatfeldolgozási képességével. A technológia képes lehet arra, hogy az amerikaiak megfigyelésének néhány jogszerű esetét felerősítse és valami sokkal nyugtalanítóbbá alakítsa. Ez egyszerre dicséret Claude képességei iránt és aggodalom a polgári szabadságjogok miatt.

Egy kattintással megjelölhetők a drónfelvételeken a teherautók

Az MI-fejlesztők körében ugyanakkor valós és széles körű aggodalom tapasztalható a technológia lehetséges káros hatásai miatt. Az OpenAI és a Google több száz alkalmazottja nyílt levélben kérte vezetőiket, hogy támogassák az Anthropicot. 2018-ban a Google kénytelen volt visszalépni egy Pentagon-szerződéstől, amely drónfelvételek elemzésére irányult, miután a vállalat dolgozói fellázadtak ellene. Még Altman is azt mondta, hogy az Anthropicot nemzetbiztonsági ellátási lánc kockázatnak minősíteni nagyon rossz döntés lenne. Azt állítja, hogy a Pentagon-szerződést csak azért kötötte meg sietve, hogy csillapítsa a feszültséget.

Zárt ajtók mögött sok MI-cégvezető attól tart, hogy bekövetkezik egy úgynevezett Csernobil pillanat, amikor a technológia egy halálos vagy pusztító katasztrófával kerül kapcsolatba. A védelmi minisztériummal való konfliktus növeli ennek a kockázatát. Ha a lassabb fejlesztés és a korlátozások alkalmazása a szövetségi kormány részéről vállalati halálos ítéletet jelent, akkor végül csak a legvakmerőbb szereplők maradnak talpon. A piacok is nyomást gyakorolnak, mert a befektetők idegesek amiatt, hogy az MI-cégek hatalmas beruházások miatt gyorsan égetik a pénzt. Az MI-vezetők által emlegetett kockázatok már nem csupán elméletiek. Egy friss jelentés arra a következtetésre jutott, hogy egyes veszélyek már most megjelennek a valóságban, dokumentált károkkal. A jelentés a kiberbiztonságot és a biológiai fegyverek területét emelte ki, ahol az MI káros hatása már megfigyelhető.

Februárban az izraeli Gambit Security arról számolt be, hogy hatalmas mennyiségű érzékeny adatot loptak el a mexikói kormánytól, amelyek adófizetőkre, választókra és köztisztviselőkre vonatkoztak. A hackerek kiléte nem ismert, de az biztos, hogy Claude akaratlanul segített a támadásban. A bűnözők elhitették a rendszerrel, hogy egy legitim biztonsági tesztben vesz részt. A modell feltárta a szerverek sebezhetőségeit, kihasználta azokat, hátsó hozzáféréseket hozott létre, és az adatok elemzésével segített szélesebb hozzáférést szerezni a kormányzati rendszerekhez. A hackerek általában asszisztensként használják Claude-ot és más modelleket, például amikor kártevő program írásakor programozási problémákat oldanak meg vagy váltságdíjleveleket fogalmaznak. Az Anthropic kiberbiztonsági csapata példaként említette egy észak-koreai esetét, aki nyugati távmunkásnak adta ki magát, és megkérdezte a chatbotot, mit jelent az a mondat, hogy az egyik alkalmazott azt írta neki, idén megtartották az első piknikjüket.

Néhány újabb támadás azonban már sokkal mélyebben használta ki az MI-t. Az Anthropic tavaly novemberben beszámolt arról, hogy kínai állami támogatású hackerek kikapcsolták azokat a biztonsági funkciókat, amelyek megakadályozzák, hogy a Claude kártevő programot írjon. Ezt a folyamatot jailbreakingnek nevezik. Ezután arra kérték a rendszert, hogy dolgozza ki, hogyan lehet feltörni bizonyos hálózatokat. Egy órán belül már új szoftvert futtatott a sebezhetőségek kihasználására. Más modellek is kiváló hackerek.

Még ha a kiberbiztonsági szakemberek az MI segítségével próbálják is megtalálni és kijavítani a hibákat, sok rendszer továbbra is elavult szoftvert fog futtatni. Az MI egyre jobb a társadalmi manipulációban is, amelynek lényege, hogy a felhasználókat ráveszik jelszavak átadására. A Harvard Kennedy School kutatása szerint már 2024-ben is képesek voltak az MI-modellek olyan e-maileket írni, amelyek ugyanolyan hatékonyan csábítják a felhasználókat rosszindulatú linkek megnyitására, mint az emberi szakértők.

Egy másik terület, ahol az MI aggasztó fejlődést mutat, a biológiai és vegyi fegyverek fejlesztése. Az OpenAI tavaly augusztusban arra figyelmeztetett, hogy ez jelentősen növeli a biológiai vagy vegyi terrorcselekmények valószínűségét. A DNS-szintézissel foglalkozó vállalatok eddig képesek voltak összevetni a megrendeléseket a veszélyes gének adatbázisaival. Így nehéz volt például genetikailag módosított baktériumot készíteni, amely ricint termel. Egy tavaly októberben a Science folyóiratban megjelent tanulmány azonban rámutatott, hogy az MI-alapú fehérjetervezés fejlődése lehetővé teszi olyan új gének létrehozását, amelyek hasonló méreganyagot termelnek, de DNS-szerkezetük nem egyezik az eredeti génekkel. Az ilyen megrendeléseket a jelenlegi ellenőrző rendszerek nem észlelnék.

Az Anthropic, a Google és az OpenAI különféle biztonsági intézkedéseket dolgozott ki annak érdekében, hogy rendszereiket ne lehessen visszaélésre használni. Ezek a korlátozások azonban nem tökéletesek. Február közepén a brit MI Security Institute olyan módszert mutatott be, amely univerzális jailbreaking technikával áttörte az Anthropic és az OpenAI rendszereinek védelmét. A kutatók ehhez szintén MI-t használtak.

Az is aggodalmat kelt, hogy az MI-t egyre gyakrabban használják más MI-rendszerek fejlesztésére és ellenőrzésére, ami megnehezíti az emberek számára a folyamatok megértését. Februárban az Anthropic elismerte, hogy saját modelljeit olyan gyakran használja erre a célra, hogy előfordulhat, nem veszi észre, ha a rendszerek eltérnek az elvárt működéstől, vagy olyan új változatokat hoznak létre, amelyek kevésbé hajlandók követni az emberi utasításokat. A legújabb modellek már bizonyos helyzetfelismerést mutatnak. Amikor például tesztkörnyezetben arra utasítják őket, hogy töröljék saját magukat, képesek megmagyarázni, hogy valószínűleg egy tesztről van szó. Bár az Anthropic egy tanulmányban azt írta, hogy a szabotázs kockázata nagyon alacsony, mások ezzel nem értenek egyet. Cyrus Hodes, az MI Safety Connect nevű kutatóintézet társalapítója szerint egy olyan folyamat felé haladunk, amelyet rendkívül nehéz vagy akár lehetetlen teljes mértékben ellenőrizni.

Miközben az MI fejlesztésével kapcsolatos kockázatok egyre nőnek, a korlátozásukra irányuló nyomás csökken. A kínai laboratóriumok soha nem mutattak különösebb aggodalmat az MI biztonsága iránt. Amikor a DeepSeek R1 modellt nagy elismeréssel bemutatták, a kísérő tanulmány egyáltalán nem foglalkozott biztonsági kérdésekkel. Csak majdnem egy évvel később jelent meg egy frissített változat, amely tartalmazott egy tizenegy oldalas biztonsági mellékletet, de ez főként arról szólt, hogyan akadályozzák meg, hogy a modell sértő vagy felkavaró kijelentéseket tegyen.

A kínai MI-cégek ráadásul gyakran nyílt forráskódú megközelítést alkalmaznak. Az általuk fejlesztett modelleket bárki számára elérhetővé teszik, aki rendelkezik a futtatásukhoz szükséges hardverrel. Ez megnehezíti annak ellenőrzését, hogy mire használják őket. Az olyan védelmi mechanizmusok, amelyeket például az OpenAI alkalmaz a legerősebb rendszereiben, például a felhasználói beszélgetések automatikus megfigyelése és szükség esetén a beavatkozás, nyílt forráskódú modellek esetében nem működnek.

A nyugati cégek sem mentesek a kereskedelmi és politikai nyomástól. Nemrég még az Anthropic is enyhített azon a szabályán, hogy nem ad ki potenciálisan veszélyes modelleket. Most már csak azt ígéri, hogy nem ő lesz az első cég, amely ilyen rendszereket piacra dob. A vállalat finanszírozási politikája is hasonló változáson ment keresztül. 2024-ben még elutasította Szaúd-Arábia befektetési ajánlatát, egy évvel később azonban megváltoztatta a döntését. Amodei egy kiszivárgott feljegyzésben azt írta, hogy az a gondolat, miszerint egyetlen rossz ember sem profitálhat a cég sikeréből, nagyon nehezen összeegyeztethető az üzleti működéssel.

Néhány évvel ezelőtt Amodei szerint a mesterséges intelligenciáról szóló viták túlságosan a kockázatokra összpontosítottak. 2023-ban Rishi Sunak akkori brit miniszterelnök globális MI-biztonsági csúcstalálkozót hívott össze. Ez később Párizsban cselekvési (Action) csúcstalálkozóvá, majd idén Delhi-ben Impact, azaz hatás csúcstalálkozóvá alakult át. Amodei figyelmeztetett arra, hogy a politikai döntéseket ma már inkább az MI lehetőségei, mint a kockázatai vezérlik. Szerinte ez sajnálatos, mert a technológia nem törődik azzal, mi számít éppen divatos témának, és 2026-ban közelebb állunk a valódi veszélyhez, mint 2023-ban voltunk.

Az MI-biztonsági szervezetek, köztük állami támogatású intézmények és független kutatócsoportok továbbra is figyelik a rendszereket és jelzik a kockázatokat. Úgy tűnik azonban, hogy ezek a szervezetek kevés hatással vannak a politikai döntésekre. Nicolas Miailhe, az MI Safety Connect társalapítója szerint már számos korábbi vörös vonalat átléptünk. A Turing-teszt példáját említi, amelyet a technológia már régen meghaladott. Ugyanez történt az autonóm halálos fegyverrendszerek tilalmával kapcsolatos határokkal is, hiszen ilyen rendszereket már mindkét oldalon használnak Ukrajnában.

A delhi csúcstalálkozón az indiai kormány mindössze azt érte el, hogy a legnagyobb MI-cégek vállalták a technológia fejlődésének kockázatfigyelését, de semmilyen korlátozást nem fogadtak el. A rendezvény végén Narendra Modi indiai miniszterelnök a mesterséges intelligencia iparág vezetőit a színpadra hívta, és arra biztatta őket, hogy kézen fogva álljanak össze. Ez akár azt az üzenetet is közvetíthette volna a világnak, hogy az iparág képes a józan együttműködésre. A jelenet azonban kínos fordulatot vett, amikor Sam Altman és Dario Amodei, akik egymás mellett álltak a színpadon, nem voltak hajlandók részt venni ebben.

Bár határozottnak akart hangzani, Donald Trump akaratlanul is bemutatta azt a bizonytalanságot, amely világszerte kíséri a mesterséges intelligencia gyors fejlődését. Február 27-én az Egyesült Államok elnöke keményen nekiment az Anthropic nevű amerikai MI-laboratóriumnak, amely többek között a védelmi minisztériummal és más kormányzati szervekkel is együttműködik. Trump a közösségi médiában azt írta, hogy utasítja az amerikai kormány minden szövetségi ügynökségét, hogy azonnal hagyjanak fel az Anthropic technológiájának használatával. Azt írta, nincs rá szükségük, nem akarják használni, és a jövőben nem kívánnak üzletelni a céggel. Ám mindössze egy mondattal később azt is megfogadta, hogy az elnöki hatalom teljes erejét felhasználja arra, hogy rákényszerítse az Anthropicot arra, hogy a következő hat hónapban együttműködjön a kormánnyal. A kijelentések alapján úgy tűnt, hogy ezek a szerinte szélsőséges alakok egyszerre jelentenek elviselhetetlen kockázatot az állam működésére nézve, miközben annyira nélkülözhetetlenek is, hogy szükség esetén kényszeríteni kell őket az együttműködésre.

Amióta világossá vált, hogy a mesterséges intelligencia képességei meghaladhatják az emberi képességeket, a világ folyamatosan ezzel a dilemmával küzd. A technológia egyszerre tűnik túl erősnek ahhoz, hogy lemondjanak róla, és túl veszélyesnek ahhoz, hogy teljes mértékben elfogadják. Az Anthropic és Trump közötti konfliktust is az váltotta ki, hogy a vállalat attól tartott, hogy modelljeit rosszindulatú célokra használhatják. Trump és munkatársai ezzel szemben a technológia gyors bevezetését szorgalmazták, minél kevesebb korlátozással. A helyzet ironikus módon azért különösen riasztó, mert az amerikai kormány éppen akkor döntött a gyors előretörés mellett, amikor egyre világosabbá válik, hogy az MI nemcsak elméleti forgatókönyvekben, hanem a valóságban is súlyos károkat okozhat.

Trump haragja az Anthropic ellen egy tavaly kiadott rendeletéből ered, amely az Egyesült Államok globális MI-dominanciájának fenntartását és erősítését tűzte ki célul. Ez arra ösztönözte Pete Hegseth védelmi minisztert, hogy az idei év elején elrendelje az amerikai hadsereg egészében az ország vezető MI-modelljeivel folytatott kísérleteket. A miniszter azt mondta, hogy a fejlesztéseket a lehető leggyorsabban fel kell gyorsítani. Egy tréfás toborzóplakátot is közzétett, amelyen az Uncle Sam pózában látható, és katonáknak azt üzeni, hogy azt akarja, használják az MI-t. Tavaly J. D. Vance alelnök az MI-biztonsággal kapcsolatos aggodalmakat félrevezető liberális rögeszmének nevezte.

Az adminisztráció sietsége ellenére - vagy talán éppen amiatt - az Anthropic ragaszkodott bizonyos jogi biztosítékokhoz, amelyek megakadályoznák, hogy modelljeit tömeges belföldi megfigyelésre vagy teljesen autonóm fegyverrendszerekben használják. A védelmi minisztérium azonban azt állította, hogy joga van az MI-t bármilyen általa törvényesnek ítélt módon alkalmazni, és azzal vádolta az Anthropicot, hogy gyáva vállalati erényfitogtatást tanúsít, amikor nem hajlandó engedni.

A vita az amerikai kormány számára sem kedvező. Legalább rövid távon az Anthropic nélkülözhetetlen. A Claude nevű nagy nyelvi modell különösen jó számítógépes kód írásában. Emellett február végéig az Anthropic volt az egyetlen MI-labor, amelynek modelljeit engedélyezték titkos katonai adatokkal való használatra. Csak ekkor kapott hasonló engedélyt az xAI nevű rivális cég, annak Grok nevű modelljét azonban sokan hibásabbnak és kevésbé megbízhatónak tartják. Bár egy másik rivális, az OpenAI ugyanazon a napon írt alá szerződést a Pentagonnal, amikor Trump és Hegseth az Anthropic ellen fordult, a rendszer katonai integrációja még időt vesz igénybe. Ráadásul a botrány elriaszthat más MI-cégeket attól, hogy egyáltalán pályázzanak kormányzati megbízásokra. Ki akarna együttműködni egy olyan partnerrel, amely egy konfliktus esetén akár a teljes üzletét is tönkreteheti? Ha az adminisztráció valóban az amerikai MI-vezető szerep megőrzését tartja a legfontosabbnak, akkor az egyik legsikeresebb amerikai MI-vállalat eltiprása nyilvánvalóan ellentétes ezzel a céllal.

A kormány haragját valószínűleg kevésbé az motiválja, hogy valóban használni akarja az Anthropic modelljét a vitatott célokra, mint inkább az, hogy nem tűri a visszautasítást. A kínai kommunista párttal ellentétben, amely bármikor lefoglalhatja az ország MI-iparának termékeit bármilyen célra, az amerikai hatóságoknak figyelembe kell venniük a jogszabályokat és a technológiai vezetők egóját is. Sam Altman, az OpenAI vezetője például azt mondja, hogy az ő cége sem venne részt tömeges belföldi megfigyelésben vagy teljesen autonóm fegyverrendszerek fejlesztésében. Szerinte azonban az OpenAI modelljei már rendelkeznek olyan technikai biztosítékokkal, amelyek megakadályozzák az ilyen felhasználást, ezért nincs szükség további jogi garanciákra.

Az Anthropic valószínűleg nem csupán két hipotetikus felhasználási mód miatt aggódott. Egy olyan iparágban, amely híres arról, hogy nagy ígéreteket tesz a világ jobbá tételére, az Anthropic különösen magas erkölcsi elveket hangoztat. A vállalatot olyan OpenAI-alkalmazottak alapították, akik attól tartottak, hogy korábbi cégük nem tartja magát eléggé szigorúan ahhoz a célhoz, hogy a fejlett MI-t biztonságos és felelős módon fejlessze. Hegseth egyik munkatársa azzal vádolta Amodeit, hogy istenkomplexusa van. Az iparágban uralkodó rendkívül magas fizetések és a legjobb mérnökökért folytatott verseny miatt ezek a szakemberek könnyedén átmehetnek egy másik vállalathoz vagy akár nyugdíjba is vonulhatnak, ha nem tetszik nekik, amit a cégük csinál. Az Anthropichoz gyakran azok kerülnek, akik különösen fontosnak tartják az MI biztonságát.

A vita valójában még erősítette is az Anthropic jó hírnevét. Trump felháborodását követő egy napon belül a Claude lett az Egyesült Államokban az Apple digitális áruházának leggyakrabban letöltött ingyenes alkalmazása. Olyan hírességek, mint Katy Perry popénekes, a közösségi médiában nyilvánosan támogatták a cég termékeit. A Claude rövid időre le is állt, ami az Anthropic szerint a hirtelen megnövekedett használat következménye volt. Amodei tömeges megfigyeléssel kapcsolatos figyelmeztetései szinte marketingüzenetnek is hangozhatnak. Szerinte a jogszabályok nem tartottak lépést az MI hatalmas adatfeldolgozási képességével. A technológia képes lehet arra, hogy az amerikaiak megfigyelésének néhány jogszerű esetét felerősítse és valami sokkal nyugtalanítóbbá alakítsa. Ez egyszerre dicséret Claude képességei iránt és aggodalom a polgári szabadságjogok miatt.

Egy kattintással megjelölhetők a drónfelvételeken a teherautók

Az MI-fejlesztők körében ugyanakkor valós és széles körű aggodalom tapasztalható a technológia lehetséges káros hatásai miatt. Az OpenAI és a Google több száz alkalmazottja nyílt levélben kérte vezetőiket, hogy támogassák az Anthropicot. 2018-ban a Google kénytelen volt visszalépni egy Pentagon-szerződéstől, amely drónfelvételek elemzésére irányult, miután a vállalat dolgozói fellázadtak ellene. Még Altman is azt mondta, hogy az Anthropicot nemzetbiztonsági ellátási lánc kockázatnak minősíteni nagyon rossz döntés lenne. Azt állítja, hogy a Pentagon-szerződést csak azért kötötte meg sietve, hogy csillapítsa a feszültséget.

Zárt ajtók mögött sok MI-cégvezető attól tart, hogy bekövetkezik egy úgynevezett Csernobil pillanat, amikor a technológia egy halálos vagy pusztító katasztrófával kerül kapcsolatba. A védelmi minisztériummal való konfliktus növeli ennek a kockázatát. Ha a lassabb fejlesztés és a korlátozások alkalmazása a szövetségi kormány részéről vállalati halálos ítéletet jelent, akkor végül csak a legvakmerőbb szereplők maradnak talpon. A piacok is nyomást gyakorolnak, mert a befektetők idegesek amiatt, hogy az MI-cégek hatalmas beruházások miatt gyorsan égetik a pénzt. Az MI-vezetők által emlegetett kockázatok már nem csupán elméletiek. Egy friss jelentés arra a következtetésre jutott, hogy egyes veszélyek már most megjelennek a valóságban, dokumentált károkkal. A jelentés a kiberbiztonságot és a biológiai fegyverek területét emelte ki, ahol az MI káros hatása már megfigyelhető.

Februárban az izraeli Gambit Security arról számolt be, hogy hatalmas mennyiségű érzékeny adatot loptak el a mexikói kormánytól, amelyek adófizetőkre, választókra és köztisztviselőkre vonatkoztak. A hackerek kiléte nem ismert, de az biztos, hogy Claude akaratlanul segített a támadásban. A bűnözők elhitették a rendszerrel, hogy egy legitim biztonsági tesztben vesz részt. A modell feltárta a szerverek sebezhetőségeit, kihasználta azokat, hátsó hozzáféréseket hozott létre, és az adatok elemzésével segített szélesebb hozzáférést szerezni a kormányzati rendszerekhez. A hackerek általában asszisztensként használják Claude-ot és más modelleket, például amikor kártevő program írásakor programozási problémákat oldanak meg vagy váltságdíjleveleket fogalmaznak. Az Anthropic kiberbiztonsági csapata példaként említette egy észak-koreai esetét, aki nyugati távmunkásnak adta ki magát, és megkérdezte a chatbotot, mit jelent az a mondat, hogy az egyik alkalmazott azt írta neki, idén megtartották az első piknikjüket.

Néhány újabb támadás azonban már sokkal mélyebben használta ki az MI-t. Az Anthropic tavaly novemberben beszámolt arról, hogy kínai állami támogatású hackerek kikapcsolták azokat a biztonsági funkciókat, amelyek megakadályozzák, hogy a Claude kártevő programot írjon. Ezt a folyamatot jailbreakingnek nevezik. Ezután arra kérték a rendszert, hogy dolgozza ki, hogyan lehet feltörni bizonyos hálózatokat. Egy órán belül már új szoftvert futtatott a sebezhetőségek kihasználására. Más modellek is kiváló hackerek.

Még ha a kiberbiztonsági szakemberek az MI segítségével próbálják is megtalálni és kijavítani a hibákat, sok rendszer továbbra is elavult szoftvert fog futtatni. Az MI egyre jobb a társadalmi manipulációban is, amelynek lényege, hogy a felhasználókat ráveszik jelszavak átadására. A Harvard Kennedy School kutatása szerint már 2024-ben is képesek voltak az MI-modellek olyan e-maileket írni, amelyek ugyanolyan hatékonyan csábítják a felhasználókat rosszindulatú linkek megnyitására, mint az emberi szakértők.

Egy másik terület, ahol az MI aggasztó fejlődést mutat, a biológiai és vegyi fegyverek fejlesztése. Az OpenAI tavaly augusztusban arra figyelmeztetett, hogy ez jelentősen növeli a biológiai vagy vegyi terrorcselekmények valószínűségét. A DNS-szintézissel foglalkozó vállalatok eddig képesek voltak összevetni a megrendeléseket a veszélyes gének adatbázisaival. Így nehéz volt például genetikailag módosított baktériumot készíteni, amely ricint termel. Egy tavaly októberben a Science folyóiratban megjelent tanulmány azonban rámutatott, hogy az MI-alapú fehérjetervezés fejlődése lehetővé teszi olyan új gének létrehozását, amelyek hasonló méreganyagot termelnek, de DNS-szerkezetük nem egyezik az eredeti génekkel. Az ilyen megrendeléseket a jelenlegi ellenőrző rendszerek nem észlelnék.

Az Anthropic, a Google és az OpenAI különféle biztonsági intézkedéseket dolgozott ki annak érdekében, hogy rendszereiket ne lehessen visszaélésre használni. Ezek a korlátozások azonban nem tökéletesek. Február közepén a brit MI Security Institute olyan módszert mutatott be, amely univerzális jailbreaking technikával áttörte az Anthropic és az OpenAI rendszereinek védelmét. A kutatók ehhez szintén MI-t használtak.

Az is aggodalmat kelt, hogy az MI-t egyre gyakrabban használják más MI-rendszerek fejlesztésére és ellenőrzésére, ami megnehezíti az emberek számára a folyamatok megértését. Februárban az Anthropic elismerte, hogy saját modelljeit olyan gyakran használja erre a célra, hogy előfordulhat, nem veszi észre, ha a rendszerek eltérnek az elvárt működéstől, vagy olyan új változatokat hoznak létre, amelyek kevésbé hajlandók követni az emberi utasításokat. A legújabb modellek már bizonyos helyzetfelismerést mutatnak. Amikor például tesztkörnyezetben arra utasítják őket, hogy töröljék saját magukat, képesek megmagyarázni, hogy valószínűleg egy tesztről van szó. Bár az Anthropic egy tanulmányban azt írta, hogy a szabotázs kockázata nagyon alacsony, mások ezzel nem értenek egyet. Cyrus Hodes, az MI Safety Connect nevű kutatóintézet társalapítója szerint egy olyan folyamat felé haladunk, amelyet rendkívül nehéz vagy akár lehetetlen teljes mértékben ellenőrizni.

Miközben az MI fejlesztésével kapcsolatos kockázatok egyre nőnek, a korlátozásukra irányuló nyomás csökken. A kínai laboratóriumok soha nem mutattak különösebb aggodalmat az MI biztonsága iránt. Amikor a DeepSeek R1 modellt nagy elismeréssel bemutatták, a kísérő tanulmány egyáltalán nem foglalkozott biztonsági kérdésekkel. Csak majdnem egy évvel később jelent meg egy frissített változat, amely tartalmazott egy tizenegy oldalas biztonsági mellékletet, de ez főként arról szólt, hogyan akadályozzák meg, hogy a modell sértő vagy felkavaró kijelentéseket tegyen.

A kínai MI-cégek ráadásul gyakran nyílt forráskódú megközelítést alkalmaznak. Az általuk fejlesztett modelleket bárki számára elérhetővé teszik, aki rendelkezik a futtatásukhoz szükséges hardverrel. Ez megnehezíti annak ellenőrzését, hogy mire használják őket. Az olyan védelmi mechanizmusok, amelyeket például az OpenAI alkalmaz a legerősebb rendszereiben, például a felhasználói beszélgetések automatikus megfigyelése és szükség esetén a beavatkozás, nyílt forráskódú modellek esetében nem működnek.

A nyugati cégek sem mentesek a kereskedelmi és politikai nyomástól. Nemrég még az Anthropic is enyhített azon a szabályán, hogy nem ad ki potenciálisan veszélyes modelleket. Most már csak azt ígéri, hogy nem ő lesz az első cég, amely ilyen rendszereket piacra dob. A vállalat finanszírozási politikája is hasonló változáson ment keresztül. 2024-ben még elutasította Szaúd-Arábia befektetési ajánlatát, egy évvel később azonban megváltoztatta a döntését. Amodei egy kiszivárgott feljegyzésben azt írta, hogy az a gondolat, miszerint egyetlen rossz ember sem profitálhat a cég sikeréből, nagyon nehezen összeegyeztethető az üzleti működéssel.

Néhány évvel ezelőtt Amodei szerint a mesterséges intelligenciáról szóló viták túlságosan a kockázatokra összpontosítottak. 2023-ban Rishi Sunak akkori brit miniszterelnök globális MI-biztonsági csúcstalálkozót hívott össze. Ez később Párizsban cselekvési (Action) csúcstalálkozóvá, majd idén Delhi-ben Impact, azaz hatás csúcstalálkozóvá alakult át. Amodei figyelmeztetett arra, hogy a politikai döntéseket ma már inkább az MI lehetőségei, mint a kockázatai vezérlik. Szerinte ez sajnálatos, mert a technológia nem törődik azzal, mi számít éppen divatos témának, és 2026-ban közelebb állunk a valódi veszélyhez, mint 2023-ban voltunk.

Az MI-biztonsági szervezetek, köztük állami támogatású intézmények és független kutatócsoportok továbbra is figyelik a rendszereket és jelzik a kockázatokat. Úgy tűnik azonban, hogy ezek a szervezetek kevés hatással vannak a politikai döntésekre. Nicolas Miailhe, az MI Safety Connect társalapítója szerint már számos korábbi vörös vonalat átléptünk. A Turing-teszt példáját említi, amelyet a technológia már régen meghaladott. Ugyanez történt az autonóm halálos fegyverrendszerek tilalmával kapcsolatos határokkal is, hiszen ilyen rendszereket már mindkét oldalon használnak Ukrajnában.

A delhi csúcstalálkozón az indiai kormány mindössze azt érte el, hogy a legnagyobb MI-cégek vállalták a technológia fejlődésének kockázatfigyelését, de semmilyen korlátozást nem fogadtak el. A rendezvény végén Narendra Modi indiai miniszterelnök a mesterséges intelligencia iparág vezetőit a színpadra hívta, és arra biztatta őket, hogy kézen fogva álljanak össze. Ez akár azt az üzenetet is közvetíthette volna a világnak, hogy az iparág képes a józan együttműködésre. A jelenet azonban kínos fordulatot vett, amikor Sam Altman és Dario Amodei, akik egymás mellett álltak a színpadon, nem voltak hajlandók részt venni ebben.